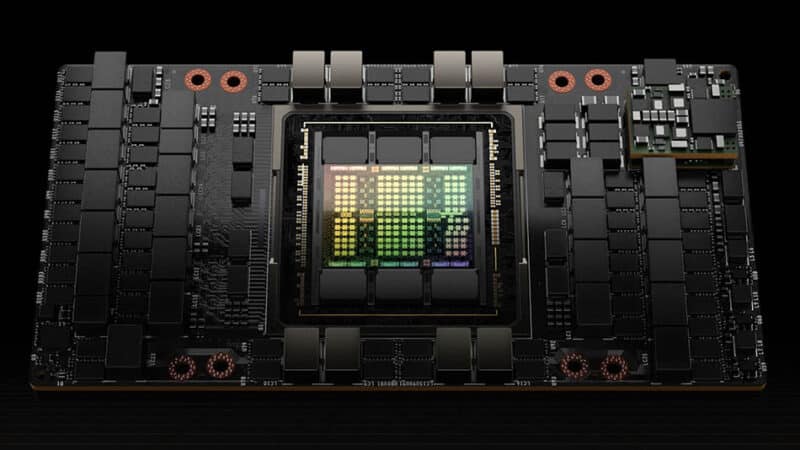

Según se informa, el líder del mercado de chips de IA, NVIDIA, está interesado en probar la última generación de memoria de alto ancho de banda (HBM) de SK Hynix. Si las dos partes colaboran con éxito, ayudará a consolidar la posición de liderazgo de SK Hynix en el mercado de HBM.

Las memorias HBM3 actual, presentes en las NVIDIA H100, operan a 6.4 Gbps. Aunque un salto en su versión mejorada con 8 Gbps podría parecer pequeño, es importante recordar que el rendimiento de estos sistemas está estrechamente ligado al ancho de banda. Por ello, se espera que se priorice la memoria más rápida disponible en el mercado. NVIDIA, liderada por Jensen Huang, ha solicitado muestras a SK Hynix con el objetivo de integrar la memoria HBM3E con NVIDIA Blackwell, específicamente, con el chip B100.

No será una tarjeta grafica Gamer

No estamos hablando del sucesor de la RTX 4090, sino de la H100. En otras palabras, nos referimos a la GPU que se destinará a servidores, un mercado en el que NVIDIA puede permitirse adoptar infraestructuras más costosas y utilizar diseños más complejos. Aunque aún no está confirmado, hay fuertes indicios de que la GPU B100 podría estar compuesta por varios chips y albergar más de seis pilas de memoria HBM3E.

Aún desconocemos la configuración exacta, pero vale la pena mencionar que TSMC ya tiene la capacidad de construir sistemas con ocho pilas de este tipo de memoria. Podemos referirnos a los casos de las Instinct MI250X y MI300A/MI300X de AMD, ambos sistemas multichip.

En Computex 2023, se mencionó a Blackwell como el próximo Hopper, anticipando un nuevo incremento de rendimiento para el próximo año, pero sin ofrecer detalles. Sin embargo, es importante recordar que muchas de las tecnologías que han facilitado el desarrollo de los nuevos procesadores de alto rendimiento computacional (HPC) de AMD son de TSMC, y NVIDIA podría aprovecharlas.

NVIDIA pondrá en marcha lo mas avanzado del mercado

El diseño más avanzado que tenemos hasta ahora es lo que los ingenieros de la compañía denominaron Composable On-Package Architecture (COPA), que es simplemente otra forma de referirse a las GPU divididas en varios chips diferentes, tal como ya lo han hecho AMD e Intel. Se espera que las principales mejoras de la arquitectura incluyan el uso de caché de tercer nivel, así como el incremento en la cantidad de pilas de memoria HBM de 6 a 10.

Con dicha configuración, el futuro chip de NVIDIA con HBM3E podría alcanzar una velocidad de ancho de banda de 10 TB/s, un número impresionante por donde se le mire. Por ahora desconocemos cómo será la configuración de esta poderosa GPU en términos del número de multiprocesadores de streaming (SM). En cualquier caso, tendremos que esperar hasta 2024 para saberlo con certeza.

Fuente: Digitimes