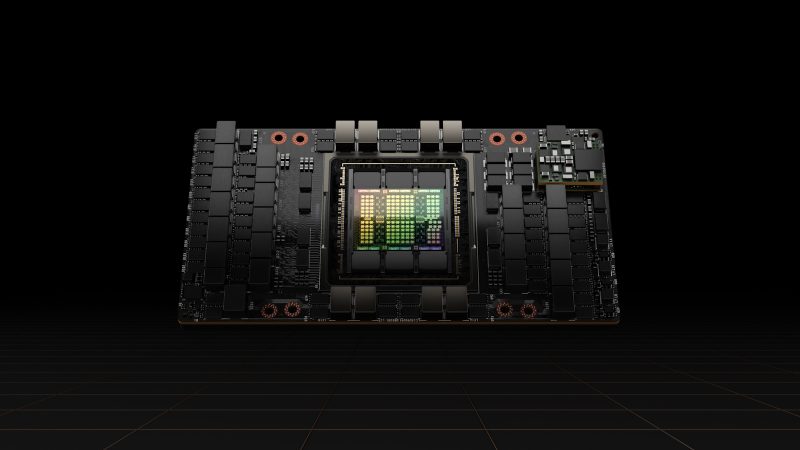

En GTC 2022, Nvidia reveló detalles de su arquitectura Hopper y la GPU Nvidia H100. La arquitectura Hopper y la GPU H100 no deben confundirse con Ada Lovelace, la arquitectura centrada en el consumidor que impulsará las futuras tarjetas GeForce.

La Hopper H100 reemplazará a la Ampere A100, que reemplazó a Volta V100. Esto es Hardware para centros de datos, y con una competencia feroz entre los fabricantes como las tarjetas Instinct MI250/250X de AMD y el recientemente anunciado Instinct MI210, Nvidia busca retomar el liderazgo en la computación de alto rendimiento.

Como era de esperar, la H100 fue diseñada para supercomputadoras con un enfoque en capacidades de inteligencia artificial. Incluye numerosas actualizaciones y sobre el A100 actual, todas diseñadas para alcanzar nuevos niveles de rendimiento y eficiencia.

Hopper contiene 80.000 millones de transistores y está construido con un proceso llamado N4 a 4nm personalizado de TSMC, ligeramente diferente del proceso N4 de 4 nm que también ofrece TSMC. A modo de comparación, la GPU A100 tenía solo 54 mil millones de transistores.

Nvidia no ha revelado la velocidad de la GPU en la nueva tarjeta, pero ha dado algunos otros detalles. La H100 es compatible con la interfaz NVLink de cuarta generación de Nvidia, que puede proporcionar hasta 128 GB/s de ancho de banda. También es compatible con PCIe 5.0 para sistemas que no usan NVLink, que también alcanza un máximo de 128 GB/s. La conexión NVLink actualizada proporciona 1,5 veces más ancho de banda que en los A100, mientras que PCIe 5.0 ofrece el doble de ancho de banda que PCIe 4.0.

Un Gran salto en el rendimiento.

La H100 también admitirá 80 GB de memoria HBM, con 3 TB/s de ancho de banda, eso es 1,5 veces más rápido que la HBM2E del A100. Si bien el A100 estaba disponible en modelos de 40 GB y 80 GB, tanto el H100 como el A100 todavía usan hasta seis pilas de módulos HBM. En general, el H100 tiene un 50 % más de memoria y ancho de banda en comparación con su predecesor.

Esa es una buena mejora, pero otros aspectos de la GPU Hopper implican mejoras aún mayores. La H100 puede proporcionar hasta 2000 TFLOPS de cómputo FP16 y 1000 TFLOPS de cómputo TF32, así como 60 TFLOPS de cómputo FP64 de uso general, lo que triplica el rendimiento del A100 en los tres casos.

La GPU Hopper también agrega soporte mejorado para FP8 con hasta 4000 TFLOPS de cómputo, seis veces más rápido que el A100 (que tuvo que depender de FP16 ya que no tenía soporte nativo para FP8). Para ayudar a optimizar el rendimiento, Nvidia también tiene un nuevo motor transformador que cambia automáticamente entre los formatos FP8 y FP16 según la carga de trabajo.

Nvidia también ha agregado nuevas instrucciones DPX diseñadas para acelerar la programación dinámica. Esto puede ayudar con una amplia variedad de algoritmos, incluida la optimización de rutas y la genómica, y Nvidia afirma que el rendimiento de estos algoritmos es hasta 7 veces más rápido en Hopper H100 que en las GPU de la generación anterior, y hasta 40 veces más rápido que en la anterior. GPU de última generación Algoritmos basados en CPU. Hopper también incluye cambios para mejorar la seguridad, y en los sistemas de virtualización de GPU ahora permite que siete instancias seguras se ejecuten en una sola GPU H100.

Que pasa con el Consumo

Todos estos cambios son importantes para los objetivos de la IA y supercomputación de Nvidia. A pesar del cambio a un nodo de fabricación más pequeño, el TDP del H100 para la variante SXM se incrementó a 700 W, en comparación con los 400 W de los módulos A100 SXM. Eso es un 75 % más de potencia, para mejoras que parecen oscilar entre el 50 % y el 500 % según la carga de trabajo. En general, esperamos que el rendimiento sea dos o tres veces más rápido que la de la Nvidia A100, por lo que debería haber una mejora del 50% en la eficiencia.

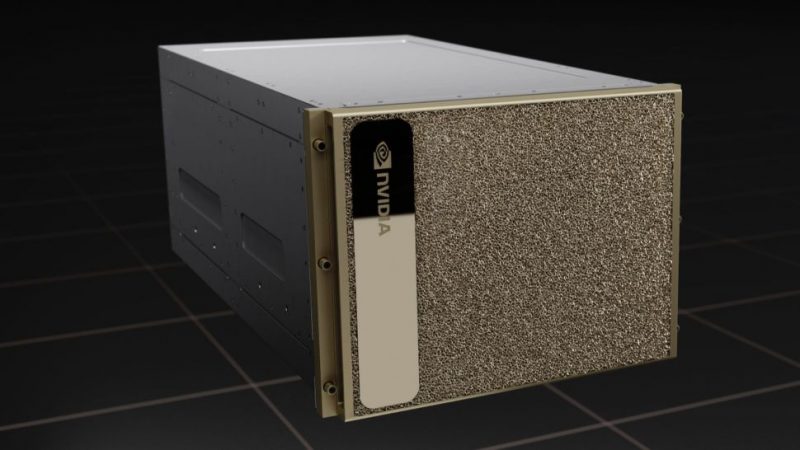

Al igual que con el A100, Hopper estará inicialmente disponible los servidores DGX H100. Cada sistema DGX H100 contiene ocho GPU H100, que proporcionan hasta 32 PFLOPS de cómputo AI y 0,5 PFLOPS de FP64, con 640 GB de memoria HBM3. El DGX H100 también tiene 3,6 TB/s de ancho de banda.

Supercomputadora EOS, equipada con los nuevos DGX H100

Usando múltiples servidores DGX H100, Nvidia se expande a un DGX SuperPod con 32 sistemas DGX H100, vinculados a un sistema NVLink Switch actualizado y una red Quantum-2 InfiniBand. Un solo SuperPod H100 cuenta con 256 GPU H100, 20 TB de memoria HBM3 y hasta 1 ExaFLOPS de cómputo AI, al mismo tiempo que ofrece 70,4 TB/s de ancho de banda.

Por supuesto, las supercomputadoras se pueden construir usando múltiples SuperPods, y Nvidia ha anunciado su nueva supercomputadora Eos que sigue los pasos de Selene. El Eos se construirá a partir de 18 SuperPods H100, con 576 sistemas DGX H100 y 360 conmutadores NVLink, y proporcionará 275 PFLOPS de cómputo FP64.