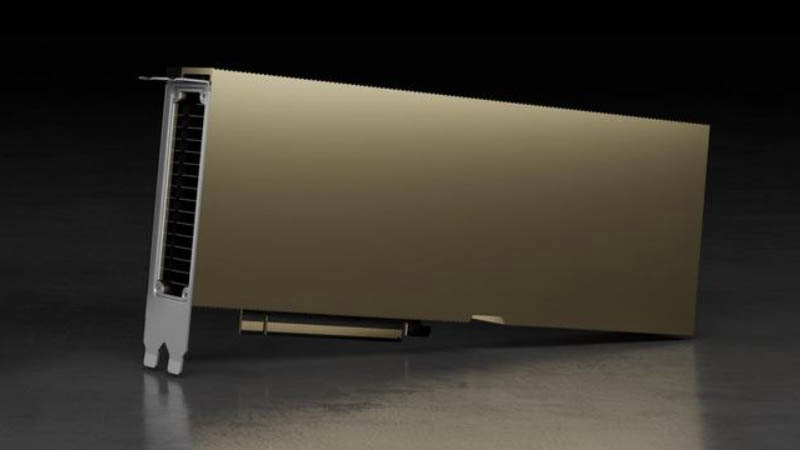

Tras su filtración de la semana pasada, Nvidia anunció oficialmente la versión PCIe de su aceleradora A100 80GB, diseñada para tareas de cómputo de alto rendimiento relacionadas a la Inteligencia Artificial.

Esta nueva versión de la GPU A100 utiliza la interfaz PCI-Express 4.0 en vez de una conexión SXM4 como la versión original anunciada en noviembre , permitiendo instalarla en placas madre para estaciones de trabajo convencionales y no solamente en placas madre especiales diseñadas para ser colocadas en racks. Dado que cuenta con un sistema de refrigeración inferior por cuestiones de tamaño, su TDP se redujo a 250W, frente a los 400W de la versión SMX4, lo que reducirá su frecuencia boost sostenida.

Para quienes no están al tanto de las especificaciones de la A100 80GB original, les contamos que cuenta con 6192 Cuda Cores Ampere, 432 Tensor Cores de 3ra. Generación, y 80GB de memoria HBM2E con ancho de banda de 2TB/s, siendo una auténtica bestia para tareas de Inteligencia Artificial. Todas estas especificaciones se mantienen en esta nueva versión PCIe, cambiando solamente el TDP como mencionamos previamente.

Las primeras estaciones de trabajo de Atos, Cisco, Dell Technologies, Fujitsu, H3C, HPE, Inspur, y Lenovo basadas en la A100 PCIe ya se encuentran a la venta desde hoy, por lo que su disponibilidad en el mercado es inmediata.

¿Qué opinan sobre la nueva A100 PCIe de Nvidia?

Fuente: TechPowerUp