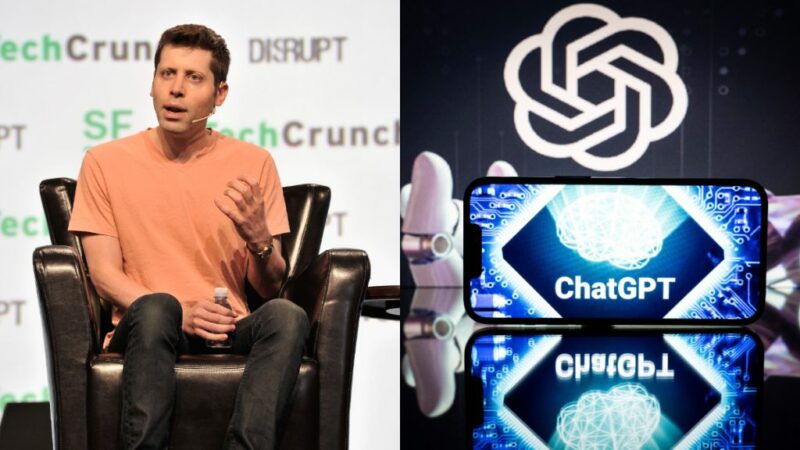

Hoy, Sam Altman, CEO de OpenAI, ha declarado ante la cámara alta de los Estados Unidos, advirtiendo sobre las posibles amenazas que podrían surgir de la tecnología de inteligencia artificial producida tanto por su organización como por otras similares. Hizo un llamado a los senadores para que establezcan regulaciones estrictas, como requisitos de licencia, a las entidades que diseñan y desarrollan sistemas avanzados de inteligencia artificial, como GPT-4 de OpenAI.

“Creemos que la intervención regulatoria de los gobiernos será fundamental para mitigar los riesgos de modelos de IA cada vez más poderosos”, dijo Altman. “Por ejemplo, el gobierno de EE. UU. podría considerar una combinación de requisitos de licencia y prueba para el desarrollo y lanzamiento de modelos de IA por encima de un umbral de capacidades”.

Además Altman dijo que le preocupa que la industria de la IA pueda “causar un daño significativo al mundo”.

Aunque Altman destacó las enormes ventajas que la IA puede ofrecer, admitió que en OpenAI están “sumamente inquietos” por la posibilidad de que las elecciones sean influenciadas por el contenido generado por la IA. “A la vista de las elecciones del próximo año y de cómo estos modelos siguen mejorando, pienso que este es un aspecto crítico que nos debe preocupar… Creo que sería muy prudente establecer cierta regulación en esta materia”, señaló Altman.

La IA un problema real para todos

El escenario de este intercambio de palabras fue una audiencia organizada por el Subcomité de Privacidad, Tecnología y Ley del Comité Judicial del Senado, donde también ofreció su testimonio Christina Montgomery, la principal responsable de privacidad y confianza de IBM.

“IBM hace un llamado al Congreso para que adopte una estrategia de regulación focalizada para la IA”, manifestó Montgomery. “Esto significa establecer directrices para controlar el despliegue de la IA en aplicaciones específicas, sin necesidad de regular la tecnología”. Montgomery sostuvo que el Congreso debería identificar claramente los riesgos asociados a la IA y aplicar “normas”, con las más rigurosas “dirigidas a las aplicaciones que presenten los mayores peligros para los individuos y la sociedad”.

El gobierno quiere controla pero seguir avanzando

Habiendo escuchado a todos los oradores, solo uno de los Senadores asistentes, Richard Blumenthal, optó por compartir su perspectiva, lo cual podría establecer un precedente y, quizás, formar el cimiento de la nueva ley que será objeto de análisis en los meses por venir:

“Las corporaciones dedicadas a la IA deberían tener la obligación de probar sus sistemas, revelar los riesgos identificados y permitir el examen de investigadores autónomos. Hay contextos en los que el peligro de la IA es tan agudo que deberíamos contemplar restricciones o incluso su prohibición total, en particular cuando se refiere a violaciones de la privacidad con fines comerciales y decisiones que impactan directamente en la subsistencia de las personas.

No tiene lógica intentar poner freno al progreso de la IA. El mundo no nos va a esperar, la comunidad científica global no se va a detener. Contamos con rivales que avanzan, y optar por la ignorancia no es la solución”, reflexionó Blumenthal.

En cualquier caso, el Senador tiene una parte de la verdad, al menos en cuanto a que Europa se encuentra alineada con EE.UU. en términos de regulación y protección de empresas y personas. Sin embargo, China y Rusia… Están jugando en el otro extremo del tablero y están pisando a fondo el acelerador. Descubrir la ruta para regular la IA, de manera que no cause daño alguno, es el desafío. La solución a este enigma, la descubriremos a su debido tiempo.

Fuente: Arstechnica