Riot Games ha publicado hoy un informe en el que se describe el estado actual de las medidas contra la toxicidad en Valorant, así como el futuro de dichos esfuerzos, incluyendo un programa beta para grabar y analizar las comunicaciones de voz de los jugadores denunciados por chat abusivo.

Los términos de servicio de Riot se actualizaron para dar cabida a este cambio el año pasado, y Riot comenzará un despliegue beta de su programa de moderación de voz dentro de 2022. El informe es poco detallado, pero se supone que la grabación y el análisis de las comunicaciones de voz para la moderación sólo se utilizarán cuando un jugador ya haya sido denunciado por comportamiento tóxico.

Estaría bueno saber más detalles sobre el programa antes de su implementación, como cuántas veces tendrán que ser denunciados los jugadores antes de ser vigilados, así como si el castigo y el proceso de apelación serán diferentes de los programas anti-toxicidad que Riot ya tiene en marcha. Además, Riot ya tomó medidas restrictivas en el pasado, pero no estamos seguros que hayan sido del todo efectivas.

El parte principal del informe se enfoca en exponer el sistema actual de Valorant para silenciar las palabras ofensivas en el chat de texto, la naturaleza esencial de los informes de los jugadores para influir positivamente en el juego, y los resultados de estos sistemas, tal y como se refleja en el índice de prohibiciones y restricciones de las comunicaciones.

Las restricciones aumentan, pero los jugadores siguen siendo tóxicos.

Y aunque los castigos van en aumento, las encuestas a los jugadores de Riot muestran que la percepción del acoso en Valorant se mantiene estable. En palabras de Riot:

“{…}nos hemos dado cuenta de que la frecuencia con la que los jugadores se encuentran con el acoso en nuestro juego no ha disminuido significativamente. En resumen, sabemos que el trabajo que hemos hecho hasta ahora es, en el mejor de los casos, fundacional, y hay mucho más que construir sobre él en 2022 y más allá”. Me impresionó que Riot admitiera esta discrepancia en lugar de limitarse a citar el aumento del índice de moderación como una victoria.

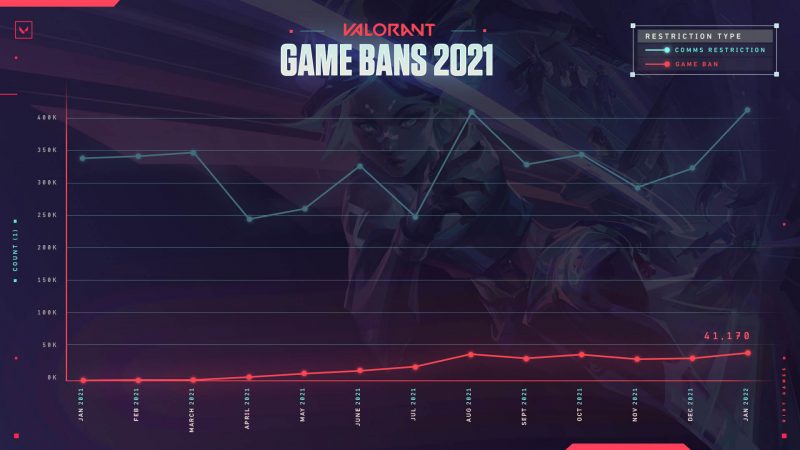

Por ejemplo, el siguiente gráfico provisto por Riot muestra como han escalado los casos de baneos en Valorant (la línea marcada en rojo):

Es decir, por lo que se puede apreciar, el sistema de control y baneos funciona. Pero lo cierto es que el problema de la comunidad tóxica perdura. El problema de la toxicidad en Riot games no es cosa reciente, dado que su popular MOBA, League of Legends está clasificado como uno de los juegos cuya comunidad es más tóxica, según varios reportes. Basta googlear para notar que en varios informes, tanto League of Legends (LoL) o Valorant, aparecen casi siempre en el top 10 ranking.

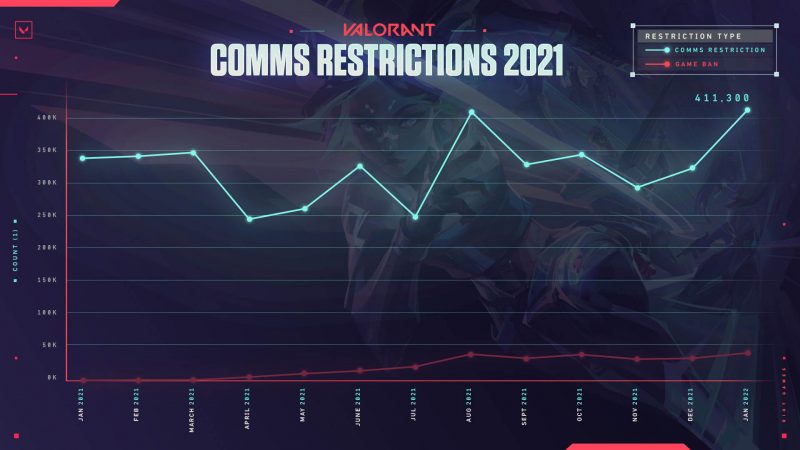

El siguiente gráfico muestra en cambio, como han aumentado las medidas de SOFT BAN, es decir, baneos parciales, en este caso, restricción del sistema de comunicaciones In-game para algunos jugadores tóxicos:

Lo cual, tampoco es una solución del todo viable. Al ser un juego Free-to-Play, el gran problema que persiste, es que el jugador baneado, simplemente va y se crea otra cuenta. Así de simple. Y la historia vuelve a repetirse una vez más.

Otras medidas que aportará Riot para la solución del problema

Riot describe además qué otras medidas tomará en el futuro inmediato que incluyen:

“Moderación de texto más inmediata y en tiempo real” – que implica mayores restricciones al chat y cambios a la política de “tolerancia cero” que Riot aplica para algunas palabras aplicadas en el chat.

“Mejoras en la moderación de voz existente” – que implica la publicación de actualizaciones regulares que mejoren la efectividad de este programa de moderación.

“Programa piloto regional de pruebas”– que implica la aplicación de un programa similar al aplicado en la región de Turquía respecto a la moderación y supervisión de los reportes, que al haber probado ser más efectivo que otros, cambiarían las directrices establecidas en otras regiones a modo de prueba para comprobar si son efectivas también en dichas regiones.

Por eso mismo, la cuestión persiste. ¿Estas medidas son lo correcto?

“Espiar” a los jugadores, o dejar que sean tóxicos. Yo no creo que se trate de las únicas opciones que tiene Riot. Otra de las opciones que podrían aplicar sería restringir de alguna manera, las recompensas que el usuario gana en el juego ni bien sea reportado. Por ejemplo: que se bloquee su sistema de recompensas hasta que se confirme si el jugador fue correctamente baneado o no. De esta manera, el jugador puede llegar a persistir en su conducta y jugar, pero no recibirá ningún tipo de recompensas de, digamos: misiones, drops, experiencia u otras cosas de valor. Y si bien su cuenta permanecería activa, el sistema de recompensa/castigo implícito en esta mecánica, acabaría por funcionar a la larga.

En League of Legends hay un sistema similar, el del “Honor”, donde los jugadores que mejor se comportan son votados por sus compañeros de equipo, y cuando acumulan cierto honor persistente, el sistema los recompensa con drops. Si el jugador es reportado, su “barra de honor” cae a 0, y deja de recibir recompensas. Con Valorant podrían hacer lo mismo. Pero igualmente, no creemos que funcione del todo. La toxicidad es algo demasiado arraigado en dicha comunidad.

Así que más allá del hecho de que Riot empezará a “espiar” a sus jugadores, no vemos una solución posible en el horizonte. Por lo pronto, este sistema probará ser más o menos efectivo con el tiempo. Mientras tanto, nosotros, los jugadores, seguiremos esperando que esto no entorpezca la jugabilidad.

¿Y a ustedes que les parece esto de que Riot grabará los chats de voz? ¿Servirá para algo? ¿Está bien que hagan esto? Queremos escuchar sus opiniones.

Fuente: Pcgamer