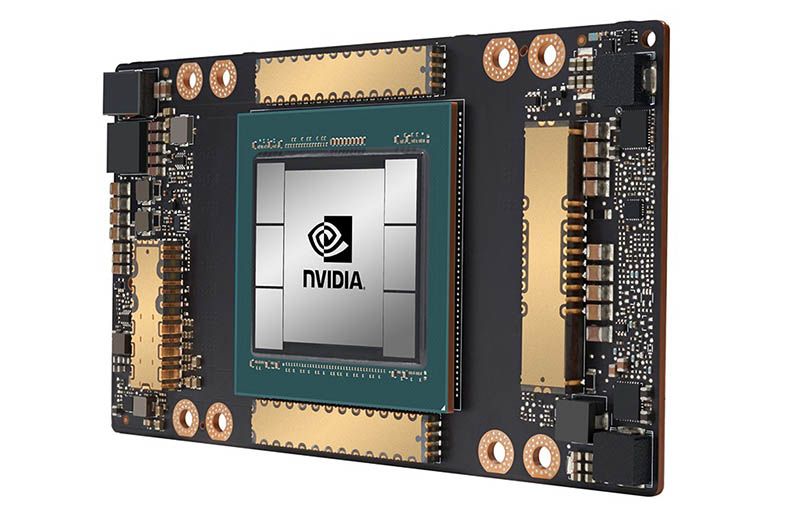

En un inusual anuncio desde su cocina, Jensen Huang presentó de manera oficial su nueva arquitectura para GPUs y tarjetas de cómputo «Ampere», junto a la nueva A100, su primer producto insignia basado en esta arquitectura.

Diseñada para suceder a la Tesla V100 basada en Volta, esta nueva A100 tiene el mismo propósito que su predecesora: Ofrecer el máximo rendimiento posible en inteligencia artificial que permitan las tecnologías actuales. Estas son algunas de sus características principales:

- Más de 54 mil millones de transistores, siendo la unidad de procesamiento fabricada a 7nm más grande del mundo

- Tensor Cores de Tercera Generación con TF32, un nuevo formato matemático que acelera el entrenamiento de IA de precisión single, ofreciendo hasta 20x más rendimiento que FP32 sin cambios en el código. También soporta FP64, ofreciendo hasta 2.5x más rendimiento que Volta.

- Múltiples instancias de GPU, o MIG, permitiendo que una sola A100 sea particionada en hasta 7 GPUs independientes, cada una con sus propios recursos.

- NVLink de 3ra. Generación, duplicando la conexión de alta velocidad entre GPUs, permitiendo que los servidores con A100 actúen como una sola GPU gigante.

Todo esto permite obtener 6x más rendimiento que Volta en entrenamiento de IA, y 7x más rendimiento en inferencia.

Lamentablemente no hay demasiada información sobre sus especificaciones, aunque sabemos lo siguiente:

- 6912 Cuda Cores

- 40GB de VRAM HBM2e

- Ancho de banda de memorias de 1.55GB/s

- Soporte a NVLINK 3.0 con ancho de banda de hasta 600GB/s

- Habrá versiones con factor de forma PCI-E con interfaz PCI-E 4.0

- TDP de 400W

- Fabricada bajo el proceso de 7nm de TSMC

Estas nuevas GPUs A100 estarán disponibles en el nuevo sistema DGX A100 del que hablaremos más adelante, y también en distintos servidores de los partners de Nvidia, además de múltiples supercomputadoras y servicios en la nube de Microsoft, Google, Amazon, y más.

¿Que opinan sobre las nuevas tarjetas para IA A100 de Nvidia? ¿Están ansiosos por verlas en acción?