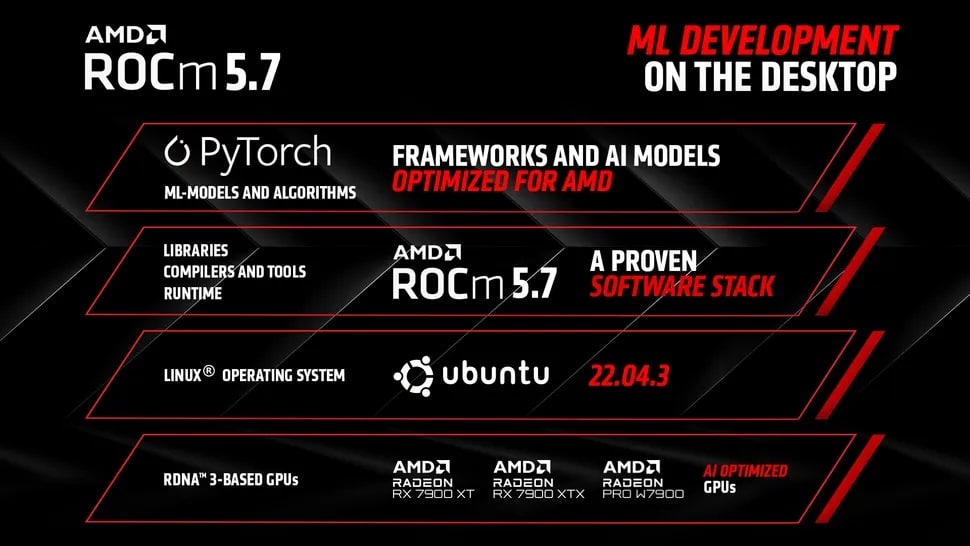

AMD ha anunciado que tres de sus GPU con arquitectura RDNA3 son aptas para trabajar con software de aprendizaje automático, estoy hablando de PyTorch y ROCm. Los modelos de tarjetas graficas son, la Radeon RX 7900 XT, RX 7900 XTX y Radeon Pro W7900.

Estas tarjetas gráficas son compatibles con la versión ROCm 5.7, que está disponible en Ubuntu 22.04.3. Además, AMD ha facilitado una guía detallada para instalar y utilizar estas herramientas.

ROCm, o Radeon Open Compute Platform, es una plataforma de código abierto creada por AMD para mejorar el rendimiento de la computación en sus tarjetas gráficas, especialmente orientada a la computación de alto rendimiento (HPC) y el aprendizaje automático.

Requisitos para el aprendizaje automático

Esta noticia representa una gran oportunidad para que las GPU de escritorio se integren más en el ámbito de la inteligencia artificial, pero no todo es positivo, AMD también ha publicado una serie de requisitos que los usuarios deben cumplir para utilizar el software.

Para soportar ROCm, se especifica que es necesario desactivar la iGPU en dos modelos de placas madre x670, la X670 Aorus Elite AX de Gigabyte y la Prime X670-P WIFI de ASUS.

Además, AMD recomienda 64 GB de RAM y una GPU con 24 GB o más de VRAM. La Radeon RX 7900 XT, con sus 20 GB de GDDR6, no es completamente apta para estos programas. Pero el mínimo requerido es de 16 GB de RAM y 8 GB de VRAM, aunque con estas especificaciones, no se podrán aprovechar todas las funciones al máximo.

AMD y el aprendizaje automático

Vale la pena señalar que AMD está ampliando el soporte de sus GPU para software de inteligencia artificial en respuesta a lo que ofrecen otros fabricantes. NVIDIA e Intel hace tiempo que dieron soporte para PyTorch.

El soporte en los tres fabricantes de chips gráficos ayudará a muchos desarrolladores a acelerar el aprendizaje automático y el desarrollo de la IA. Pero la pregunta del millón es, esta bien que den soporte para IA a estas tarjetas graficas? Se podrían encarecer en algún momento por tener esta característica? Recordemos lo que paso con la minería de criptomonedas.