Intel ha ofrecido un profundo vistazo a las innovaciones que incorporará en su próxima línea de procesadores, los Intel Core de 15ª generación, conocidos como Meteor Lake. Este será uno de los cambios más significativos en la tecnología de CPU de la empresa. Con la introducción del proceso de fabricación Intel 4 y una evolución de la microarquitectura híbrida que ya se había presentado en la 12ª generación, Alder Lake.

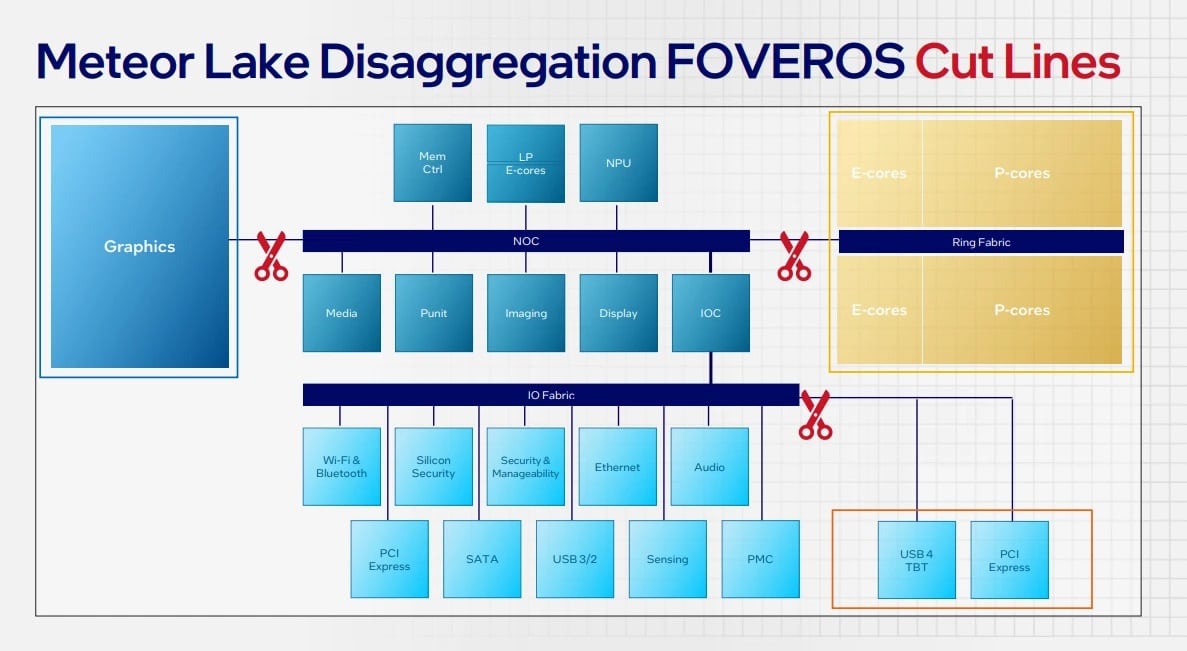

El gran pilar de innovación de los Intel Core de 15ª generación es Intel Foveros. Esta nueva técnica de construcción de chips se basa en el puente de interconexión de matrices múltiples (EMIB) integrado de Intel, o en traducción libre, el puente de interconexión de matrices múltiples. Esta tecnología ya ha sido implementada en otros productos Intel, en la línea de la serie Intel Xeon Max, y ahora estará presente en productos para el consumidor final.

EMIB sigue una lógica similar a la tecnología chiplet 2.5D presente en productos como las gráficas Radeon RDNA 2 y 3, que combinan un die con la GPU y otro con una gran cantidad de memoria o, como la llama AMD, Infinity Cache. Pero EMIB tiene una evolución importante.

La tecnología 2.5D tiene una limitación importante: apila matrices encima de otro silicio, por lo que el tamaño de la implementación está directamente relacionado con el tamaño de este intercalador. Su costo también aumenta a medida que intenta unir más dies. EMIB no tiene este problema, porque al estar agrupados los dies, este puente se conectará directamente entre sí, creando una capacidad de ampliación mucho menos costosa, al fin y al cabo son piezas mucho más compactas, y sin limitaciones máximas de área.

Tecnología 3D Foveros

Y con este puente que conecta diferentes matrices, Intel puede difundir su microarquitectura en múltiples sectores. Esto reduce costos, ya que matrices muy grandes son difíciles de fabricar sin imperfecciones, además de proporcionar versatilidad para producir diferentes componentes en diferentes arquitecturas o incluso con diferentes empresas. AMD hace esto con el Ryzen 7000, haciendo que los núcleos de procesamiento sean más caros en la litografía de 5 nm de TSMC, pero ahorra dinero al hacer IO y los gráficos integrados en 6 nm. Intel también lo hará, construyendo ella misma parte de sus procesadores y, sorprendentemente, fabricando parte de sus productos en fábricas de otras compañías, como ya hace con los Intel ARC, que fabrica TSMC.

La separación de estos dies también proporcionará una nueva flexibilidad operativa. Intel equipó cada uno de ellos con controladores de energía individuales, dando la posibilidad de activar y desactivar diferentes áreas del chip, dependiendo de la demanda de rendimiento, y creando así nuevas oportunidades para aumentar la eficiencia energética.

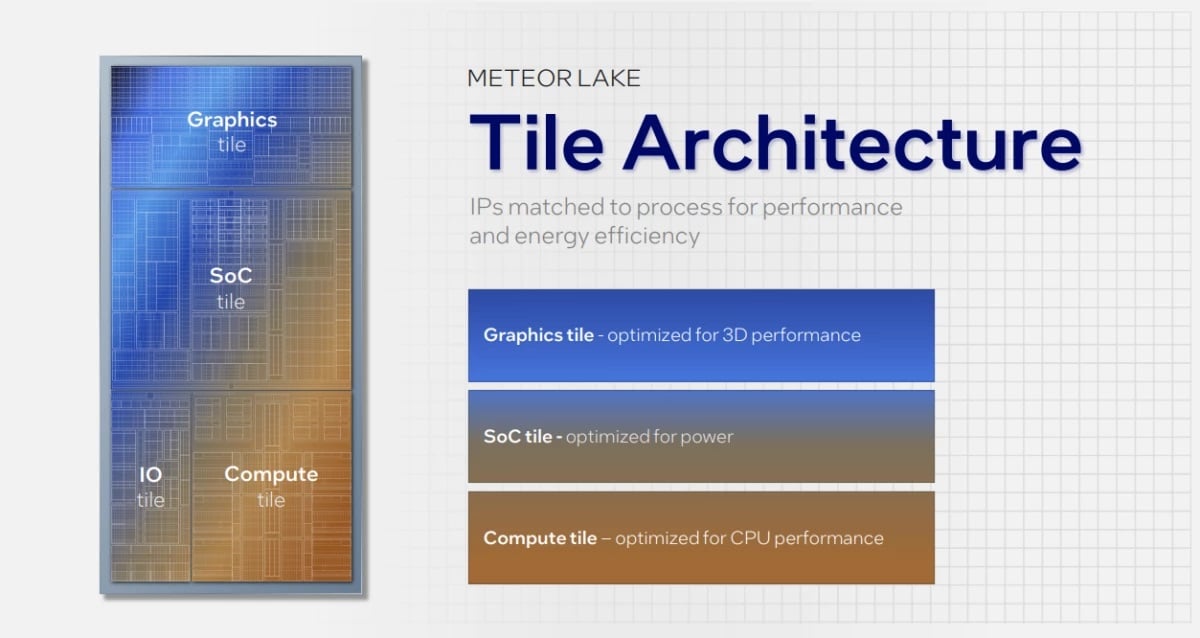

Meteor Lakes utilizará la capacidad de divide y vencerás, y se construirán muchos más dies: el die de Computación, el die SOC, el die de E/S y, finalmente, el die de gráficos. Es hora de detallar estas estructuras, y utilizar los puentes de interconexión para llegar de una a otra.

Dado de computo Intel Meteor Lake

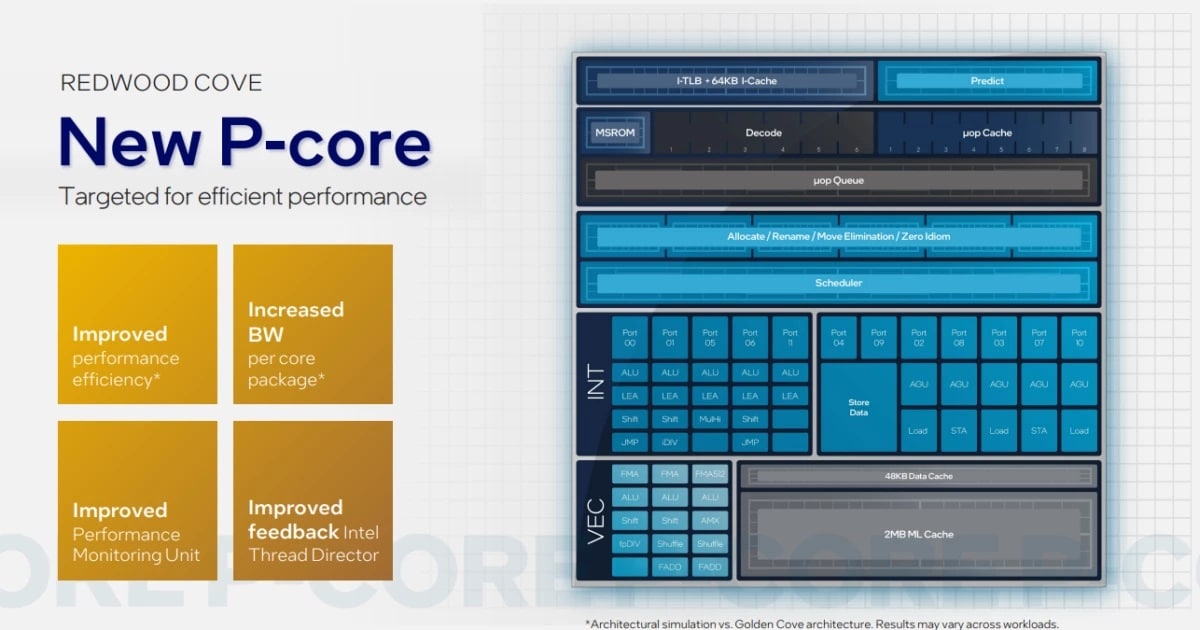

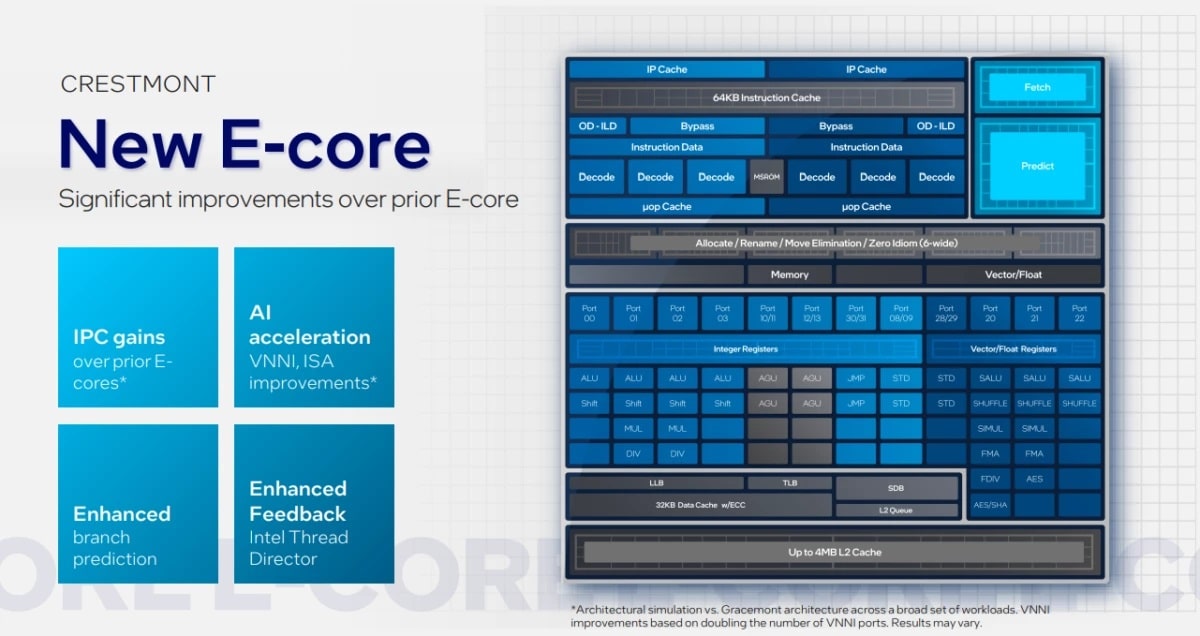

En el dado de computo, están los núcleos de procesamiento principales, separados en núcleos de rendimiento (núcleos P) y núcleos de eficiencia (núcleos E), de la misma manera que los Intel Core de 12.ª y 13.ª generación.

Los nuevos núcleos de computación Meteor Lake contarán con el nuevo proceso de fabricación, Intel 4, que utiliza la nueva técnica de litografía Extreme Ultra Violet (EUV). Esta nueva tecnología consigue una ganancia de más del 20% en eficiencia energética respecto al proceso anterior, Intel 7, y una reducción de superficie de aproximadamente un 20%.

Los núcleos de rendimiento Meteor Lake, cuyo nombre en código es Redwood Cove, traerán mejoras y optimizaciones de eficiencia energética en la unidad de monitoreo y rendimiento con Intel Thread Director, una tecnología de Intel que dirige los procesos a diferentes núcleos en función de sus características.

Los núcleos de eficiencia, con nombre en código Crestmont, traerán ganancias en IPC (instrucciones por reloj), optimizaciones en branch prediction, más rendimiento en aceleración de IA y también funcionarán de manera más eficiente con Intel Thread Director.

¿Cuánto afecta esto al rendimiento? Intel dice que habrá mejoras de rendimiento en esta parte de su CPU, pero en la presentación no reveló cifras específicas. Una pena, ya que para las personas cuyo enfoque es el rendimiento, especialmente en computadoras de escritorio, esta es la información más importante.

Unidad de procesamiento neuronal (NPU)

Intel está trazando un camino donde la inteligencia artificial (IA) estará omnipresente, comenzando en la nube y, en última instancia, llegando a las computadoras personales, realizando una amplia variedad de tareas, desde mejoras en audio, video y streaming hasta asistencia y productividad en todo lo que los usuarios hagan. Un ejemplo temprano de esto es Windows Copilot.

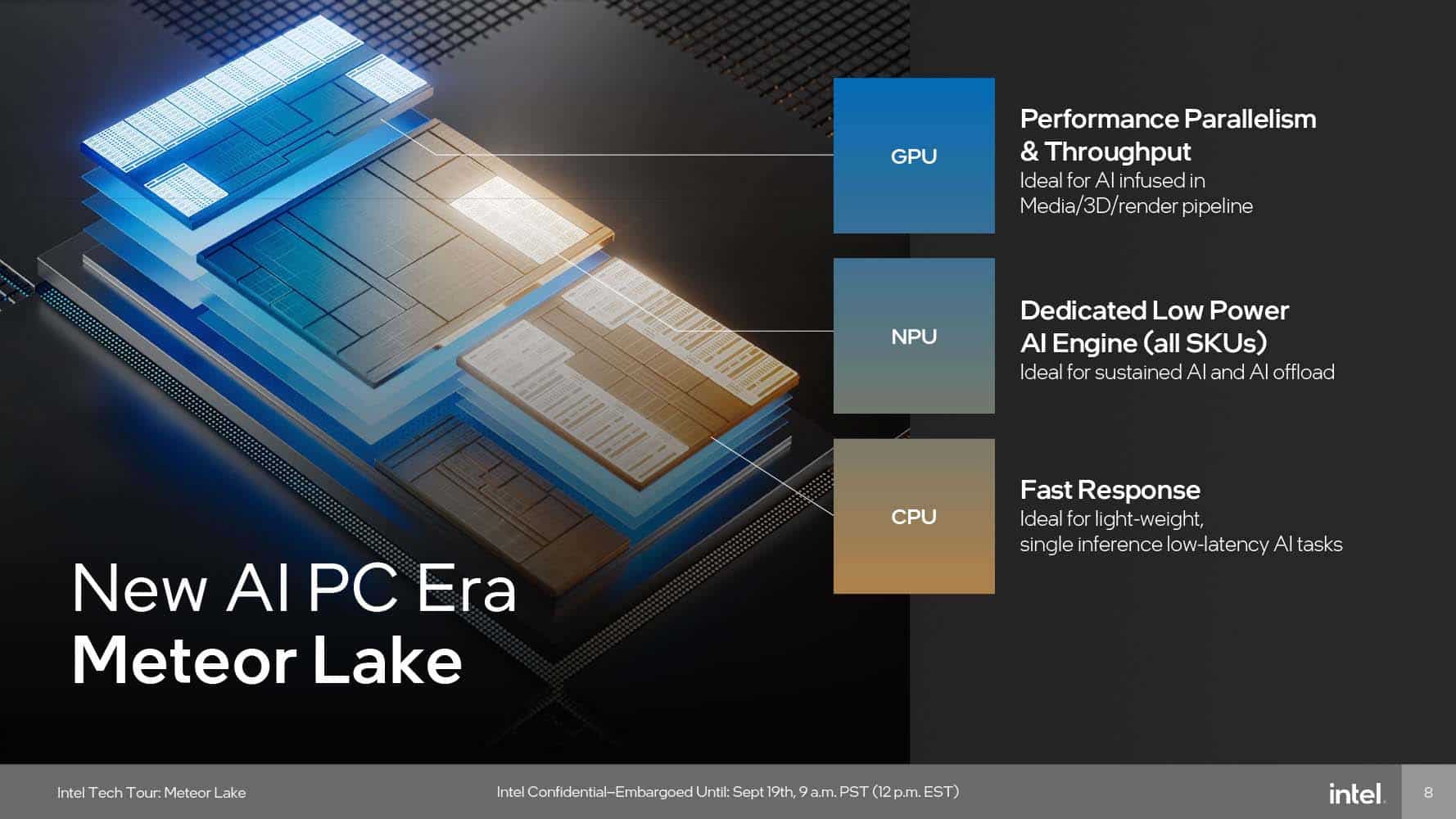

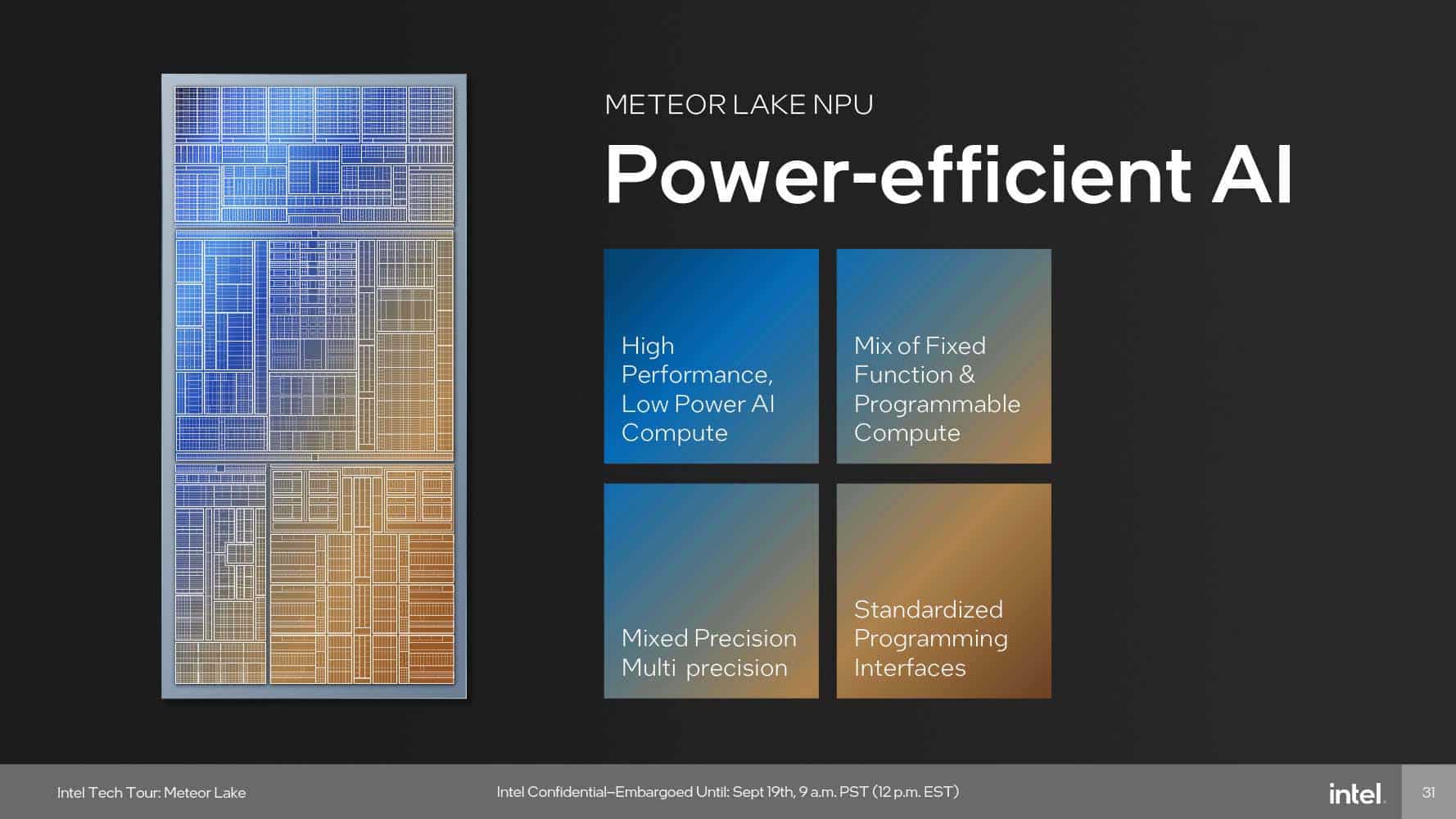

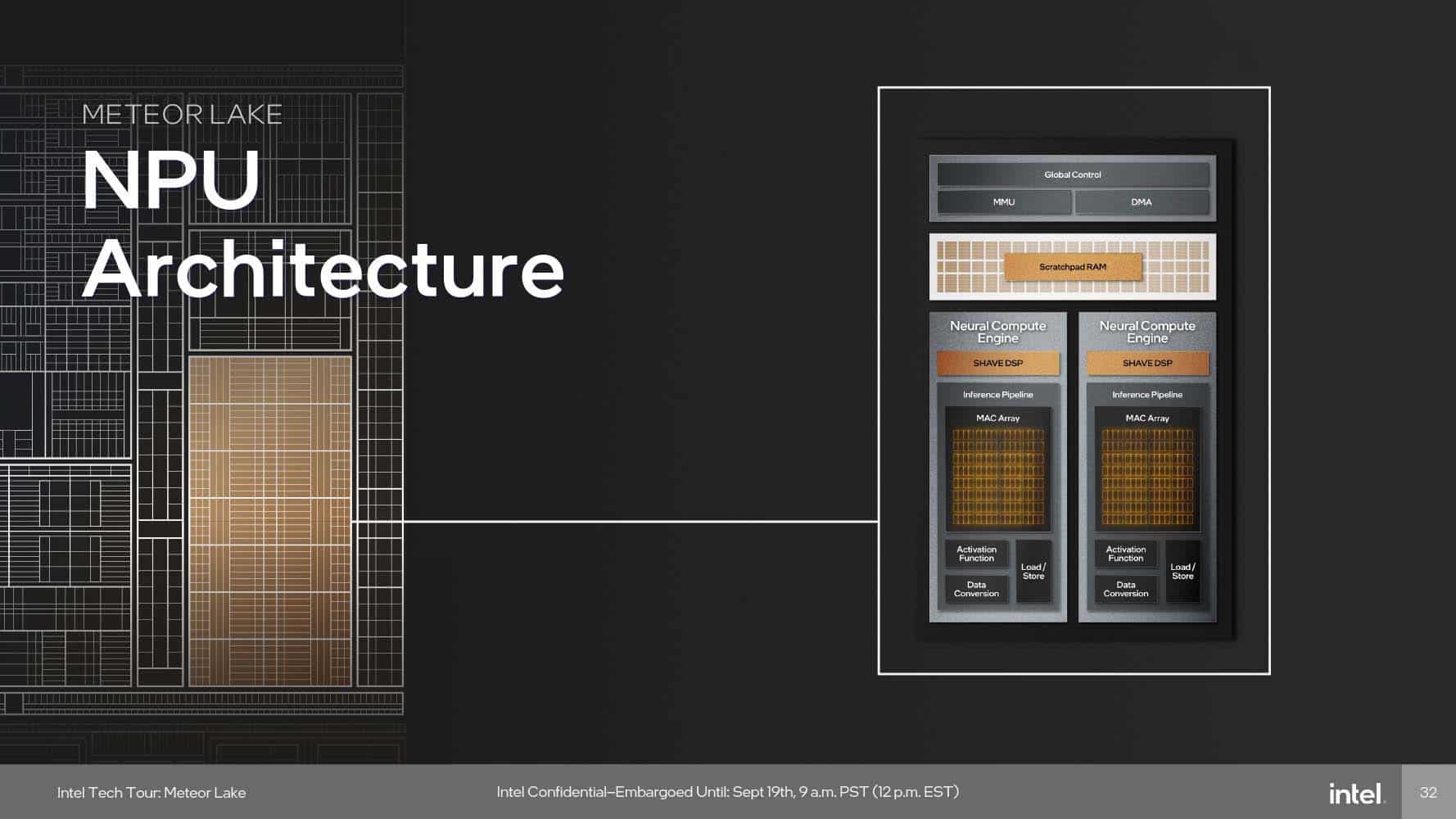

Para materializar esta visión, Meteor Lake incorpora varias secciones dedicadas a la IA. Por ejemplo, en el módulo de gráficos de la CPU, se han incluido procesos de IA diseñados para tareas de rendimiento, como el procesamiento de medios, gráficos en 3D y renderización, junto con un Procesador de Redes Neuronales (NPU) en el System on a Chip (SoC).

La distribución de estos componentes con capacidad de Inteligencia Artificial significa que las tareas relacionadas con la IA se ejecutarán con mayor velocidad y menor latencia, ya que hay una sección de la CPU dedicada a esta carga de trabajo. Esta integración marca la primera vez que Intel incluye un NPU en este tipo de productos y abre nuevas posibilidades, como la liberación de la CPU principal de algunos procesos o la ejecución de cargas de trabajo que anteriormente requerían conexión a la nube.

Inteligencia artificial, el futuro

Es importante destacar que para aprovechar esta capacidad, se requieren controladores adecuados, y Intel ha hecho que sean compatibles con una amplia variedad de modelos de lenguaje. Ya hay casos de uso práctico, como Audacity en conjunto con Riffusion, que puede utilizar el NPU de la CPU Meteor Lake para procesar de manera local un prompt específico. Además, gracias a la colaboración con Microsoft, la IA se está aprovechando en aplicaciones de Office, Windows Studio Effects, DirectML y se ha logrado compatibilidad con algunas aplicaciones de Adobe.

Adicionalmente, Intel ofrece soporte para otras herramientas con su NPU, que incluyen modelos de lenguaje avanzados como LLaMA v2, generación de imágenes mediante Stable Diffusion, optimización de imágenes y aplicaciones colaborativas como filtros de audio y correcciones de encuadre, entre otros.