Hoy, durante la Conferencia sobre Inteligencia Artificial, del Instituto Future of Life, se anunció que más de 2,400 personas y 160 compañías y organizaciones han firmado un compromiso, declarando que “no participarán ni apoyarán el desarrollo, la fabricación, el comercio o el uso de productos del tipo, armas autónomas (con Inteligencia Artificial)”. Estas personas que representan a 90 países, también piden a los gobiernos que aprueben leyes contra tales armas. Google DeepMind y la Fundación Xprize se encuentran entre los grupos que se han unido, mientras que Elon Musk y cofundadores de DeepMind, Demis Hassabis, Shane Legg y Mustafa Suleyman también han hecho esa promesa.

Esta promesa se produce cuando un puñado de empresas se enfrento a reacciones violentas sobre sus tecnologías y sobre cómo las suministran a las agencias gubernamentales y los grupos encargados de hacer cumplir la ley. Google ha sido criticado por su contrato con el Proyecto Maven en el Pentágono, que proporciona tecnología de inteligencia artificial a los militares para ayudarlos a marcar imágenes de drones que requieren una revisión humana adicional. Del mismo modo, Amazon enfrenta críticas por compartir su tecnología de reconocimiento facial con agencias de la ley, mientras que Microsoft tuvo su cuota cuando proporciono servicios a Inmigración y Control de Aduanas.

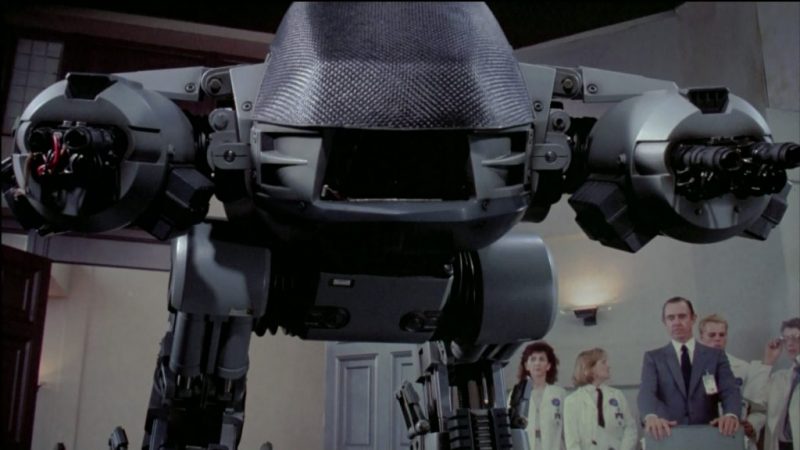

“Miles de investigadores de IA coinciden en que al eliminar el riesgo, la atribuibilidad y la dificultad de quitar vidas humanas, las armas letales autónomas podrían convertirse en poderosos instrumentos de violencia y opresión, especialmente cuando están vinculadas a sistemas de vigilancia y datos”, dice el compromiso. Agrega que aquellos que lo firman están de acuerdo en que “la decisión de tomar una vida humana nunca debería delegarse en una máquina”.

“Estoy emocionado de ver a los líderes de IA pasar de la conversación a la acción, implementando una política que hasta ahora los políticos no han logrado poner en práctica”, dijo en un comunicado el presidente del Instituto Future of Life, Max Tegmark. “La IA tiene un enorme potencial para ayudar al mundo, si estigmatizamos y prevenimos su abuso. Las armas con Inteligencia Artificial que deciden matar a las personas de manera autónoma son tan repugnantes y desestabilizadoras como las armas biológicas, y deberían tratarse de la misma manera”.

Google ya ha lanzado su propias políticas, cuyo propósito es guiar la ética de la compañía en la tecnología de inteligencia artificial. Su política establece que no diseñará ni desplegará IA para su uso en armas o vigilancia “cuyo propósito contraviene los principios ampliamente aceptados de derechos internacionales y los derechos humanos”.

Microsoft ha declarado que su trabajo con ICE se limita al correo electrónico, calendario, mensajería y administración de documentos, y no incluye ninguna tecnología de reconocimiento facial.

En 2015, Musk donó $ 10 millones al Future of Life Institute para un programa de investigación centrado en garantizar que la IA sea beneficiosa para la humanidad. Y el año pasado, Musk, Hassabis y Suleyman firmaron una carta del Future of Life Institute enviada a la ONU en donde buscaban la regulación de los sistemas de armas autónomas.

Fuente: futureoflife