AMD ha respondido a la H100 de NVIDIA con su MI300X, que lidera en las pruebas de IA, cuando funciona con su propio software. Donde la MI300X con vLLM supera a la H100 usando TensorRT-LLM.

Hace dos días, NVIDIA publicó nuevos benchmarks de sus GPU Hopper H100 para demostrar que sus chips funcionan mucho mejor que lo mostrado por AMD durante el evento «Advancing AI». Ahora, AMD comparó su nueva GPU Instinct MI300X con la Hopper H100, que ya tiene más de un año pero sigue siendo la opción más popular en la industria de la IA. Los benchmarks utilizados por AMD no tenían las bibliotecas optimizadas con TensorRT-LLM, esto proporciona un mejor rendimiento a los chips de IA de NVIDIA.

Que es la H100

La NVIDIA H100 es una tarjeta gráfica de alto rendimiento diseñada específicamente para aplicaciones de inteligencia artificial y aprendizaje profundo. Es parte de la serie Hopper de NVIDIA, que representa un salto significativo en términos de rendimiento y eficiencia en comparación con generaciones anteriores como la serie Ampere.

La H100 se basa en la arquitectura Hopper de NVIDIA y está orientada principalmente a centros de datos y aplicaciones de computación de alto rendimiento (HPC).

NVIDIA estaba primero, pero llego AMD

NVIDIA había superado claramente a AMD en el ámbito de la inferencia de IA, demostrando que la MI300X de AMD no podía mantener el ritmo. Además, NVIDIA acusó a AMD de emplear tácticas desleales. Sin embargo, AMD no se ha quedado atrás y ha respondido con una contraofensiva.

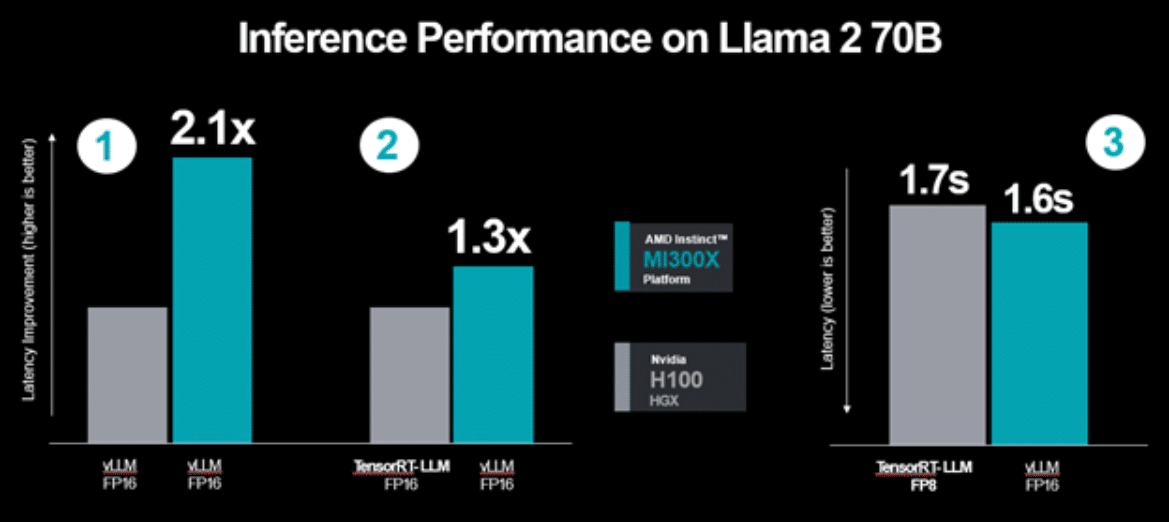

El team rojo ha llevado a cabo sus propias pruebas utilizando software propio de IA, obviamente optimizado para sus GPU. En las pruebas de rendimiento de inferencia utilizando el modelo Llama 2 70B, desarrollado por Meta, la plataforma con la MI300X de AMD ha logrado más del doble de rendimiento que la NVIDIA H100 en tareas de vLLM. Cuando se compara el uso de TensorRT-LLM en las tarjetas de NVIDIA y vLLM en las de AMD, AMD vuelve a salir victoriosa, esta vez con un 30% más de rendimiento.

Además, en términos de latencia, medida en segundos, la plataforma de AMD muestra una ligera ventaja sobre la de NVIDIA. Estos resultados indican un cambio significativo en la competencia entre estas dos gigantes de las tarjetas gráficas, con AMD demostrando su capacidad para no solo igualar sino superar a NVIDIA en ciertas áreas clave. Este desarrollo es particularmente interesante para los entusiastas y profesionales del hardware y los videojuegos de PC, quienes siempre buscan el mejor rendimiento en sus sistemas.

AMD dice que son injustas la pruebas de NVIDIA

Como dije antes, NVIDIA anteriormente acusó a AMD de manipular resultados, y ahora AMD responde diciendo que las los números de rendimiento de NVIDIA no son justos. La razón principal es el uso de TensorRT-LLM en las tarjetas H100 de NVIDIA, mientras que AMD usa vLLM, dándole a NVIDIA una ventaja en rendimiento que AMD no puede replicar. Además, AMD critica que en las pruebas de NVIDIA se emplearon diferentes estándares de precisión: FP16 para la GPU Instinct MI300X de AMD y FP8 para las H100 de NVIDIA.

AMD también acusa a NVIDIA de tergiversar los datos de latencia que AMD había publicado, buscando mostrar un rendimiento comparativamente mejor. Sin embargo, AMD sostiene que incluso con el uso de TensorRT-LLM, NVIDIA no logra superar el rendimiento de sus tarjetas gráficas. A pesar de estos desacuerdos, la competencia continuará para determinar quién lidera en el mercado de la IA. Por su parte, NVIDIA planea lanzar sus nuevas tarjetas gráficas H200 en 2024, que contarán con la arquitectura Blackwell y prometen ser más rápidas.